Ahora, veamos algunos ejemplos prácticos de lo que Cheerio puede hacer. Lo primero es lo primero: debes asegurarte de que tu entorno está completamente configurado.

No hace falta decir que debes tener Node.js instalado en tu equipo. Si no es así, simplemente sigue las instrucciones de su página web oficial, según tu sistema operativo.

Asegúrate de descargar la versión de soporte a largo plazo (LTS) y no te olvides del gestor de paquetes de Node.js (NPM). Puedes ejecutar estos comandos para asegurarte de que la instalación se ha realizado correctamente:

node -v

npm -v

El resultado debería ser similar a este:

Ahora, en cuanto al debate sobre el IDE: para este tutorial, utilizaré Visual Studio Code, ya que es bastante flexible y fácil de usar, pero puedes utilizar cualquier IDE que prefieras.

Simplemente crea una carpeta donde guardar tu pequeño proyecto y abre un terminal. Ejecuta el siguiente comando para configurar un proyecto de Node.js:

npm init -y

Esto creará una versión predeterminada del archivo package.json, que se puede modificar en cualquier momento.

Siguiente paso: instalaré TypeScript junto con las definiciones de tipos para Node.js:

npm install typescript @types/node -save-dev

He elegido TypeScript en este tutorial por su tipado estático opcional para objetos JavaScript, lo que hace que el código sea más a prueba de fallos en lo que respecta a los errores de tipado.

Esta es la misma ventaja que ha aumentado constantemente su popularidad entre la comunidad de JavaScript, según una encuesta reciente de CircleCI sobre los lenguajes de programación más populares.

Para verificar la correcta instalación del comando anterior, puedes ejecutar:

npx tsc --version

Ahora crearé el archivo de configuración tsconfig.json en la raíz del directorio del proyecto, que debería definir las opciones del compilador. Si quieres comprender mejor este archivo y sus propiedades, la documentación oficial de TypeScript te será de gran ayuda.

Si no es así, simplemente copia y pega lo siguiente:

{

"compilerOptions": {

"module": "commonjs",

"esModuleInterop": true,

"target": "es6",

"moduleResolution": "node",

"sourceMap": true,

"outDir": "dist"

},

"lib": ["es2015"]

}

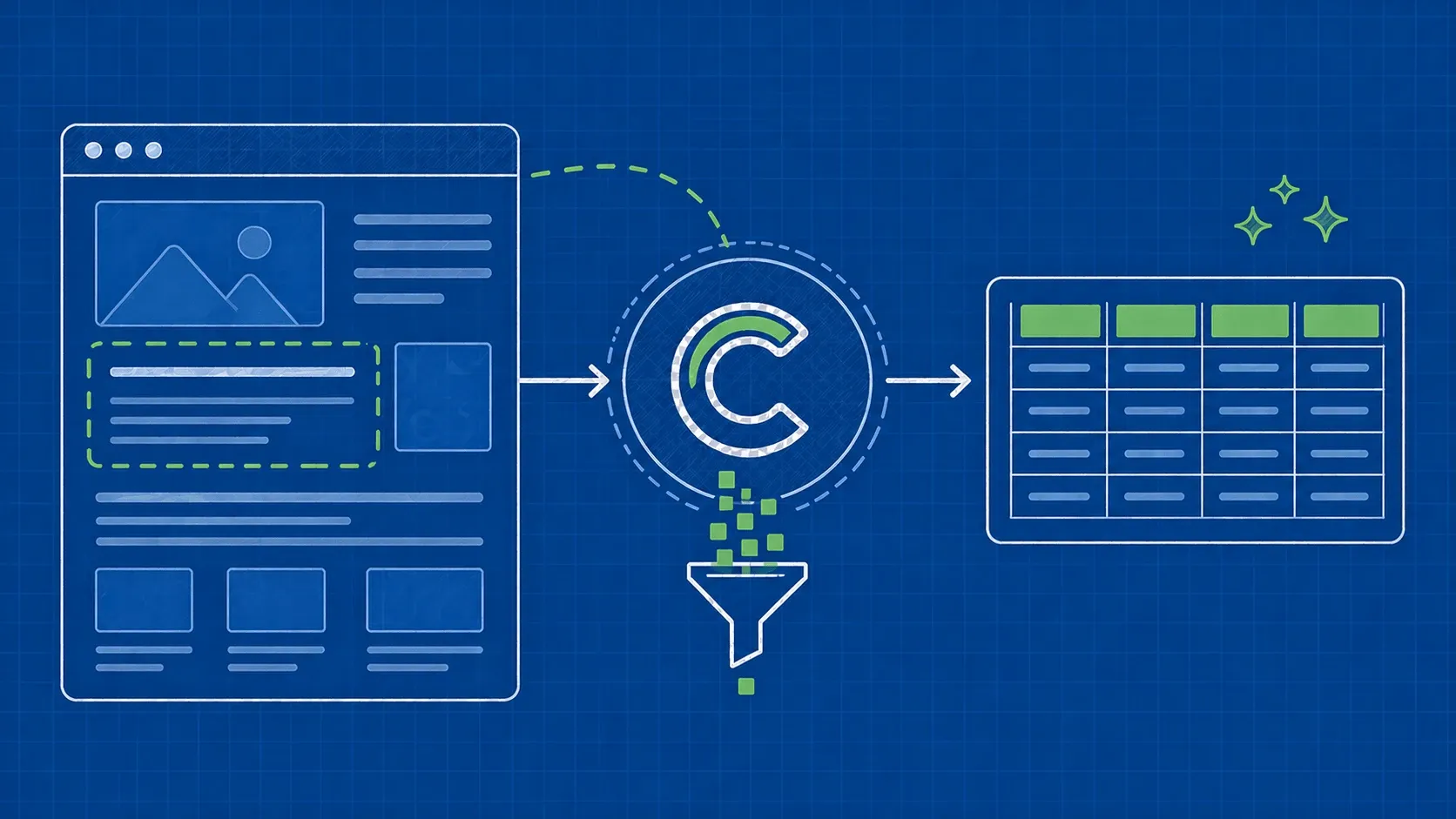

¡Ya casi está! Ahora tienes que instalar Cheerio (obviamente):

npm install cheerio

Por último, pero no menos importante, crea el directorio src, que contendrá los archivos de código. Y hablando del archivo de código, crea y coloca el archivo index.ts en el directorio src.