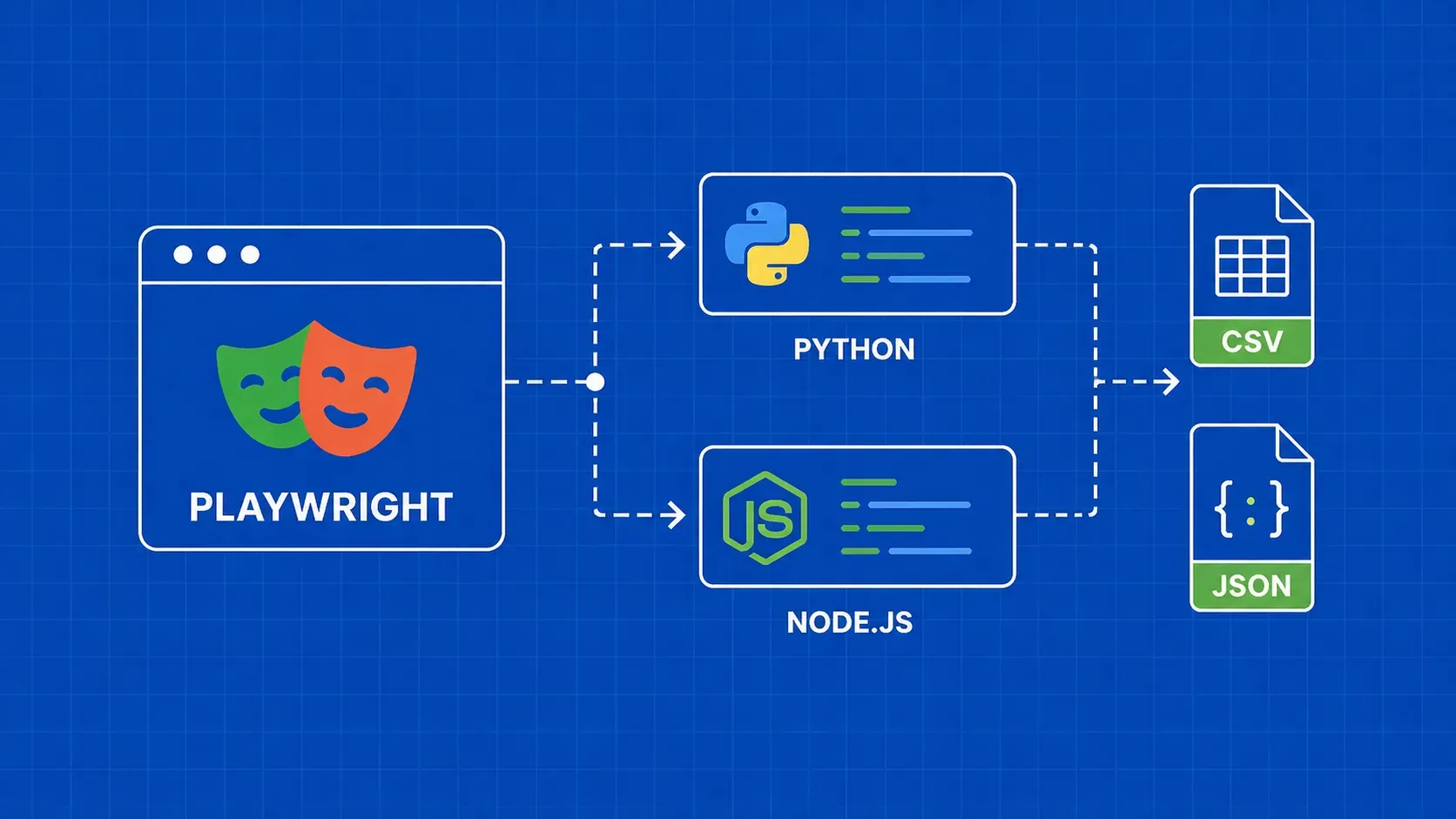

En resumen: Playwright te ofrece una automatización completa del navegador para extraer datos de sitios web con gran cantidad de JavaScript, con un soporte de primera clase tanto para Python como para Node.js. Esta guía te explica paso a paso la instalación, la extracción de elementos, la configuración del proxy, las medidas contra la detección, la paginación, la descarga de imágenes y la exportación de datos a CSV o JSON, todo ello con ejemplos de código en ambos lenguajes.

Si has intentado extraer datos de una aplicación moderna de página única con un cliente HTTP sencillo, ya sabes lo complicado que es: el HTML que obtienes es una carcasa vacía, y los datos que buscas se encuentran dentro de JavaScript que nunca se ejecuta. La extracción web con Playwright resuelve esto controlando un navegador real (Chromium, Firefox o WebKit) mediante programación, lo que permite que tu script vea exactamente lo mismo que vería un visitante humano.

Playwright es un marco de automatización de navegadores de código abierto mantenido por Microsoft. A diferencia de herramientas más antiguas, incluye de serie funciones integradas de espera automática, interceptación de red y compatibilidad con múltiples motores de navegador. Tanto si escribes en Python como en Node.js, la interfaz de la API es prácticamente idéntica, por lo que puedes elegir el lenguaje que mejor se adapte a tu pila tecnológica.

Esta guía cubre todo lo que necesitas para pasar de un terminal en blanco a scripts de scraping con Playwright listos para producción: configuración, selectores, extracción de texto e imágenes, paginación, interceptación de solicitudes, configuración de proxy, técnicas de ocultación, gestión de errores y exportación de datos estructurados. Cada técnica incluye código tanto para Python como para Node.js.